HLS + KI-Videobeschreibung: Echtzeit-Metadaten für Live- und VOD-Streams im Jahr 2026

HLS ist 2026 das dominierende Streaming-Protokoll. Erfahren Sie, wie moderne Video Description APIs Titel, Beschreibungen und Tags in Echtzeit erzeugen — für Live-Streams ebenso wie für große VOD-Bibliotheken — ganz ohne manuellen Aufwand.

HLS + KI-Videobeschreibung: Echtzeit-Metadaten für Live- und VOD-Streams im Jahr 2026

HTTP Live Streaming (HLS) hat sich 2026 als Standardprotokoll für die Videoauslieferung etabliert. Ob Sie eine Live-Sport-Plattform, eine große VOD-Bibliothek oder eine UGC-Plattform betreiben — die Chancen stehen gut, dass Sie HLS bereits einsetzen oder planen.

Doch das Problem, vor dem die meisten Plattformen noch immer stehen:

Hochwertige Titel, Beschreibungen und Tags für HLS-Inhalte in großem Maßstab zu erzeugen, ist extrem schwierig.

Klassische Ansätze (manuelles Schreiben oder einfache KI-Tools) versagen, wenn sie auf Folgendes treffen:

- Endlose Live-Streams

- Master-Playlists mit mehreren Versionen und Bitraten

- Tausende kurze Segmente

- Der Bedarf an Metadaten in Echtzeit (nicht erst Stunden später)

Genau deshalb haben wir vor Kurzem native HLS-Unterstützung zur Descrideo Video Description API hinzugefügt.

Warum HLS im Bereich Video-Metadaten alles verändert

HLS unterscheidet sich grundlegend von einfachen MP4-Dateien:

- Inhalte sind in viele kleine Segmente aufgeteilt

- Eine Master-Playlist beschreibt verfügbare Qualitäten und Auflösungen

- Live-Streams wachsen kontinuierlich

- Zuschauer können jederzeit einsteigen

Aufgrund dieser Struktur scheitern viele KI-Tools, die mit normalen Videodateien gut funktionieren, bei HLS oder liefern schlechte Ergebnisse. Sie tun dann meist nur eines:

- Analysieren nur die ersten wenigen Segmente

- Können keine Live-Inhalte verarbeiten

- Verstehen den Zusammenhang zwischen den verschiedenen Varianten nicht

Eine ordentliche, für HLS gebaute Video Description API muss das gesamte Manifest intelligent verarbeiten.

Wie Descrideo HLS-Streams verarbeitet

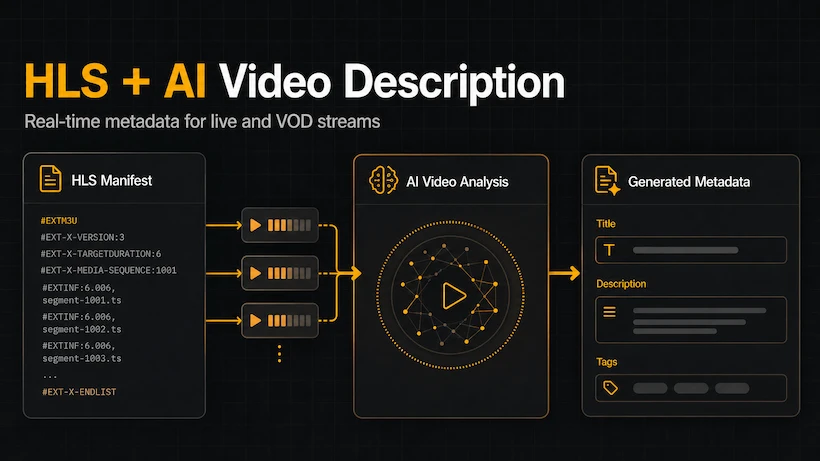

Wenn Sie eine HLS-URL an die Descrideo-API senden, geschieht Folgendes:

- Manifest-Analyse — Wir untersuchen die Master-Playlist und erkennen alle verfügbaren Versionen, Auflösungen und Codecs.

- Intelligentes Segment-Sampling — Statt jedes Segment einzeln zu verarbeiten (was langsam und teuer wäre), wählen wir repräsentative Frames über den gesamten Stream hinweg aus.

- Vision + Audio-Analyse — Wir kombinieren visuelles Verständnis mit Audiotranskription für maximale Genauigkeit.

- Echtzeit-Webhook-Zustellung — Sobald die Metadaten bereit sind, senden wir sie per signiertem Webhook an Ihr System — ganz ohne Polling.

Diese Architektur erlaubt uns, hochwertige Metadaten selbst für diese Inhalte zu erzeugen:

- Lange Live-Streams (Konzerte, Sport, Webinare)

- Große VOD-Bibliotheken mit Tausenden Stunden

- Kurzes vertikales Video (Reels, TikTok-ähnlicher Content)

Praktische Anwendungsfälle

Live-Streaming-Plattformen

Erzeugen Sie automatisch Titel und Beschreibungen für Live-Events, sobald diese starten. Kein "Live Stream" mehr als Platzhaltertitel.

VOD-Bibliotheken

Verarbeiten Sie ganze Kataloge im Hintergrund. Neue Uploads erhalten innerhalb von Minuten umfassende Metadaten, was Suche und Empfehlungen sofort verbessert.

UGC-Plattformen

Verarbeiten Sie unvorhersehbare Inhalte in großem Maßstab. Selbst wenn Nutzer HLS-Streams in unterschiedlichen Formaten und Qualitäten hochladen, liefert die API konsistente, hochwertige Metadaten.

Barrierefreiheit und Compliance

Erzeugen Sie WCAG-konforme Beschreibungen für Live- und archivierte HLS-Inhalte — etwas, das manuell früher extrem teuer gewesen wäre.

Technische Vorteile

- Unterstützung für Master-Playlists — Wir wählen automatisch die beste Qualität für die Analyse, während wir Ihre Bandbreiten-Einstellungen berücksichtigen.

- Segment-bewusste Verarbeitung — Wir verstehen die HLS-Struktur und vermeiden typische Fallstricke, an denen andere KI-Tools scheitern.

- Webhook-First-Design — Perfekt für moderne ereignisgesteuerte Architekturen.

- Konsistente Ausgabe — Dieselbe hohe Qualität, egal ob die Quelle ein 30-Sekunden-Clip oder ein 4-stündiger Livestream ist.

So starten Sie mit HLS + Descrideo

Es ist einfach:

- Senden Sie die URL Ihrer HLS-Master-Playlist an die API (genau wie bei MP4).

- Wählen Sie den Generierungsmodus (

vision,audioodervision_audio). - Erhalten Sie strukturierte Metadaten per Webhook (Titel, Beschreibung, Tags und sogar VideoObject-Schema).

Sie können alles direkt in unserer kostenlosen Sandbox testen — keine Kreditkarte erforderlich.

Möchten Sie sehen, wie gut KI Ihre HLS-Inhalte beschreiben kann?

Descrideos kostenlose Sandbox testen → Testen Sie echte HLS-Streams in wenigen Minuten.

Sehen Sie, wie andere Teams es einsetzen: Praxisnahe Use Cases entdecken →

Descrideo ist eine developer-first Video Description API mit nativer HLS-Unterstützung, die visuelle und akustische Analyse kombiniert, um präzise, SEO-bereite Metadaten für Live- und On-Demand-Inhalte in großem Maßstab zu erzeugen.